Transductive Learning and Inductive Learning

Semi-supervised Learning

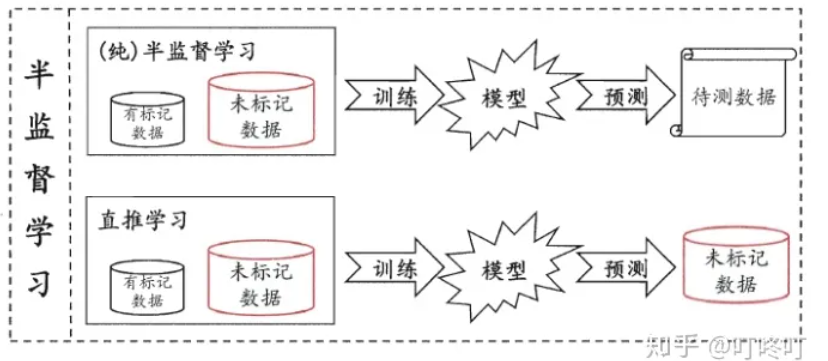

Transductive Learning(直推式学习)是Semi-supervised Learning(半监督学习)的一种。一般来说,半监督学习分为纯半监督学习(Pure/Inductive Semi-supervised Learning)和直推式学习(Transductive Learning):

Pure/Inductive Semi-supervised Learning

半监督学习出现的一大诱因是现实世界中带标签的数据往往很少,大多数的数据都是无标签的。充分利用这些无标签数据来提高神经网络的性能就是半监督学习的目的。

纯半监督学习是最原始的半监督学习。在纯半监督学习中,训练集为$\mathcal{D}=\left\{\mathbf{X} _\text{tr},\mathbf{Y} _\text{tr}, \mathbf{X} _\text{unlabelled} \right\}$,测试集为$\mathcal{T}=\left\{\mathbf{X} _\text{te},\mathbf{Y} _\text{te}\right\}$。在训练的过程中,半监督学习的神经网络能够利用无标签样本$\mathbf{X} _\text{unlabelled}$的信息,但是计算损失$\mathcal{L}$时利用的只是$\mathbf{X} _\text{tr}$和$\mathbf{T} _\text{tr}$,且测试集在训练过程中仍是不可见的。因为目前很多的神经网络都是基于消息传递的,如Attention Mechanism、GCN等,这样的设置使得神经网络在训练过程中能够获得$\mathbf{X} _\text{unlabelled}$传来的信息,这能在一定程度上提高网络的性能。

Transductive Learning

直推式学习是另外一种形式的半监督学习,但是它学习的目的与纯半监督学习完全不同。纯半监督学习的目的是利用无标签的数据来提高模型性能、泛化能力,它从训练样本中归纳出数据间的潜在规律,以期能预测未知的样本。

不同于纯半监督学习,直推式在训练过程中就已经知道将来要预测什么,因为它并不要求在整个样本分布上都达到很好的性能,而只是期望在给定的预测样本上达到最好的性能。

在直推式学习中,训练集为$\mathcal{D}=\left\{\mathbf{X} _\text{tr},\mathbf{Y} _\text{tr}, \mathbf{X} _\text{te} \right\}$,测试集为$\mathcal{T}=\left\{\mathbf{X} _\text{te},\mathbf{Y} _\text{te}\right\}$。它在训练的过程中已经看过的测试样本的特征,只是没有用其标签来计算损失函数$\mathcal{L}$。在GNN中,直推式学习是很普遍的,常见的GCN、SGC等都是基于直推式学习的。

Inductive Learning

一般的深度学习都属于Inductive Learning(归纳式学习),即训练集是$\mathcal{D}=\left\{\mathbf{X} _\text{tr},\mathbf{Y} _\text{tr} \right\}$,测试集是$\mathcal{T}=\left\{\mathbf{X} _\text{te},\mathbf{Y} _\text{te}\right\}$。测试样本在训练的过程中完全不可知。